Mindless Machines. Über die Suche nach den richtigen Worten – ohne ChatGPT

zurück.

Das Morgen ist zum Heute geworden. Schon wieder ist die Zukunft eingetreten – die Vision einer künstlichen Intelligenz, einer non-humanen Entität, die den Menschen überwindet, ein wiederkehrendes Narrativ. In den vergangenen zwei Jahren hat ein rasanter Aufstieg von nutzerfreundlichen generativen KI-Systemen stattgefunden: DALL-E, Midjourney, Stable Diffusion, ChatGPT von OpenAI – im Technologie- und Kunstdiskurs als Innovation auf Gutenberg-Level verhandelt. Man kennt die Filme, die Bücher, die Worte. Sie alle zeichnen ähnliche Bilder: KI als Bedrohung, als Endzeit-Vision, daneben der enchanted determinism[1], der die Dystopie zur Utopie umdeutet.

Nach zahllosen Anläufen ist dieser Text endlich geschrieben. Ein Anfang, der vielleicht sogleich wieder endet. Die einen warnen, die anderen imaginieren. Der Mythos beginnt schnell zu bröckeln, sobald man den Tab zu ChatGPT geöffnet hat. Der Wunsch, mit Künstlicher Intelligenz eine Co-Autorschaft einzugehen, scheitert an den gemeinsamen Worten. Das generierte Output ergibt keinen Sinn:

„Für Ihren Essay könnten Sie eine Szene beschreiben, in der ein Mensch versucht, einen Text über ChatGPT zu schreiben, aber aufgrund von LLM’s (Mindless Machines) Schwierigkeiten hat, die richtigen Worte zu finden. Die Szene könnte die Frustration und die ungewöhnlichen Gedanken und Ideen des Schreibenden zeigen, während er versucht, mit einem künstlichen Intelligenzmodell zu kommunizieren, das möglicherweise aufgrund seiner Programmierung und fehlender menschlicher Empathie nicht in der Lage ist, die Bedeutung und Nuancen seiner Sprache vollständig zu erfassen. Vielleicht könnten Sie auch die Ironie hervorheben, dass eine Maschine, die aufgrund ihrer Programmierung als ‚mindless‘ gilt, in der Lage ist, eine menschliche Kreativität und Sprache zu inspirieren und herauszufordern“.[2]

Über etwas zu schreiben, das sich selber schreibt, ist unmöglich. Der Versuch einer Bestandsaufnahme, die sich beim Schreiben selber ad absurdum führt.

in style of

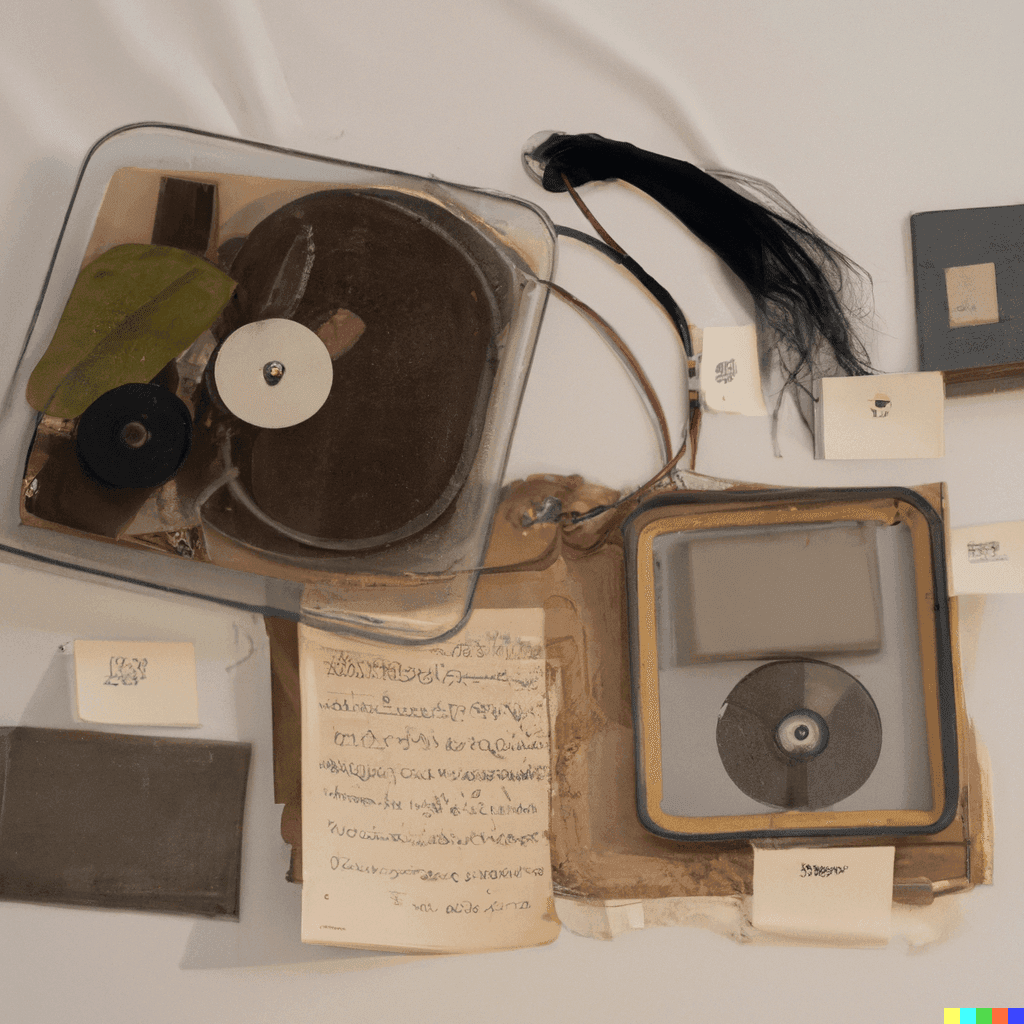

Ein Satz wird zu einem Bild, irgendein Satz zu irgendeinem Bild. Die Worte formen die Konturen, die Umrisse bleiben aber ohne sichtbare Vergangenheit. Diese Bilder erzählen keine Geschichte, sie leiden unter visueller Amnesie. Trainings-Sets formen den Blick bzw. das Output. Zuletzt lösten die Hypes einander ab: Auf NFTs folgten die Renderings im Stil der DALL-E-Ästhetik, die kurz nach dem Release der Technologie auf die Spitze getrieben wurde – ein Overkill an gleichförmigen Bildern. Analog zum NFT-Hype wird auch im Fall von DALL-E eine breite Masse mittels weniger Inputs in neue technologische Environments einzuführen versucht. Hito Steyerl beschreibt die von DALL-E und Midjourney generierten Motive als „statistical renderings“.[3] Dabei wird ein kollektives Gefühl der Entscheidungsfreiheit über die Resultate simuliert. Was mit diesen Tools erstellt wird, könnte man auch als „in style of“ beschreiben: als Versuch, Motive jenseits der eigenen Imagination zu generieren. Trotzdem entsteht der Eindruck einer simplified and bleached version of the world.

Bedeutet das das Ende der Künste und den Beginn des Age of AI Art? Die Annahme, KI könnte die Kunst ersetzen, beruht auf dem Missverständnis, dass es dazu keines ausführlicheren Prozesses mehr braucht. Inzwischen hat sich ein eigenes Vokabular um diese Entwicklungen geformt, Wörter im Dienst der Mythenbildung. „Mindless Maschines“ generieren Texte und Bilder, ohne dass je aufgehört wurde, sich ein Bewusstsein, einen Geist (mind) dahinter vorzustellen. Eine non-humane Intelligenz ohne Intelligenz.

„ A girl eating at McDonalds in style of Alfred Kubin. A still life including a ghost in style of post-internet art. A poster for a contemporary group show dealing with an old archive, 12 positions. A black and white photography of something I can’t imagine. “[4]

Wörter werden zu Bildern, basierend auf umfassenden Daten-Archiven, die den Blick der KI formen: Versuche, mittels bereits existierender Motive eine artifizielle Form der Fantasie oder Halluzination zu erzeugen. Dabei werden häufig gängige Stereotypen reproduziert. Schließlich handelt es sich um eine Technologie, die alles visualisiert, was durch Worte beschreibbar ist. Die Motive bleiben in einem Status der Beschreibung stecken, zwischen Figuration, Plakativität und Re-Kombination der Elemente, Stile und Medien. Diese fehlende Abstraktion durch Worte auszudrücken, ist schwierig. Das, wovon geträumt wurde, hat Form angenommen. Die „intelligenten“ Maschinen werden als eine mystische, unkontrollierbare Präsenz beschworen, während die generierte Sprache bei ChatGPT in ihrer Performanz mehr an Manager*innen erinnert als an das verbreitete Zukunftsbild einer KI, weit entfernt von einer realen Imitation der Nuancen von Sprache und menschlicher Kommunikation.

Diesbezüglich gilt es auch das Verhältnis von Sprache zu Bedeutung und Intention kritisch zu hinterfragen. Schließlich spricht auch DALL-E 2 eine eigene Sprache – eine Sprache des „Glitch“. K Allado-McDowell (auch verantwortlich für das Artists + Machine Intelligence Programm bei Google AI) verdeutlicht anhand konkreter Beispiele das Verhältnis und die Limitationen von menschlicher Sprache und Halluzination: „‚Apoploe vesrreaitais‘ means birds. ‚Contarra ccetnxniams luryca tanniounons‘ means bugs or pests. The prompt: ‚Apoploe vesrreaitais eating Contarra ccetnxniams luryca tanniounons‘ gives images of birds eating bugs.“[5] Die von Allado-McDowell gemeinsam mit GPT-3 geschriebenen Bücher Pharmako-AI und Amor Cringe kann man ohne Übertreibung als deepfake autofiction bezeichnen. Der Plot von Amor Cringe: Ein Influencer begibt sich auf die Suche nach Gott. Allado-McDowell lässt dabei die Worte zu einer Story kollidieren, in der die jeweiligen Ursprünge nicht mehr auszumachen sind – eine Symbiose von Sprachwelten, eine gemeinsame Halluzination. Demgegenüber hatte Trevor Paglen bereits vor Jahren in Behold these Glorious Times! (2017) beispielhaft die Kehrseite des Mythos aufgezeigt: Fotos aus Trainingsbibliotheken, die KI-Netzwerke schulen; Bedeutung und Beziehungen zu erkennen, steht dabei im Zentrum.

Neben der visuellen Komponente, den Renderings in Form von Halluzinationen, ist auch der linguistische Aspekt von Large Language Models (LLMs) ein wesentlicher Teil der Unschärfe, die mit den technologischen Entwicklungen einhergeht. Ted Chiang schreibt dazu: „Stellen Sie sich ChatGPT als ein verschwommenes JPG des gesamten Textes im Web vor. Es behält einen Großteil der Informationen im Web zurück, so wie ein JPG einen Großteil der Informationen eines Bildes mit höherer Auflösung zurückbehält, aber wenn Sie nach einer exakten Abfolge von Bits suchen, werden Sie sie nicht finden; alles, was Sie bekommen, ist eine Annäherung. Aber da die Annäherung in Form von grammatikalischem Text dargestellt wird, was ChatGPT hervorragend beherrscht, ist sie normalerweise akzeptabel. Sie sehen immer noch ein unscharfes JPEG, aber die Unschärfe tritt auf eine Weise auf, die das Bild als Ganzes nicht weniger scharf aussehen lässt.“[6] Der Unterschied zwischen sprachlicher Form und Bedeutung sollte demnach nicht unterschätzt werden. Chat GPT wird durch die die äußerliche Struktur von Worten trainiert. Auch wenn sich Form und Intention immer mehr einander annähern mögen, wird die Technologie vermutlich nie zu „verstehen“ lernen. Alles andere wird man sehen. Dieser Text wird beim Erscheinen vermutlich schon wieder veraltet sein, aber das ist vermutlich auch einer der Hauptunterschiede zwischen generierter Sprache und dem Oldschool-Schreiben, ohne die Hilfe von KI.

(Erschienen in springerin, Sharing Worlds, 2/23)

Alexander Campolo & Kate Crawford, Enchanted Determinism: Power without Responsibility in Artificial Intelligence, in: Engaging Science, Technology, and Society, Vol. 6 (2020), https://estsjournal.org/index.php/ests/article/view/277/205 ↩︎

Ein Beispiel für eine gescheiterte Co-Autorschaft mit ChatGPT. ↩︎

Hito Steyerl on Why NFTs and A.I. Image Generators Are Really Just ‘Onboarding Tools’ for Tech Conglomerates (2023), https://news.artnet.com/art-world/these-renderings-do-not-relate-to-reality-hito-steyerl-on-the-ideologies-embedded-in-a-i-image-generators-2264692 ↩︎

Individuelle Eingaben aus meiner DALL-E-History; nicht chronologisch. ↩︎

Vgl. K Allado-McDowell, Side FX. On the proliferation of images generated by machine-learning models and what they mean for the future of art (2023), https://www.hauserwirth.com/ursula/41048-side-fx-k-allado-mcdowell/ ↩︎

Ted Chiang, ChatGPT Is a Blurry JPEG of the Web. OpenAI’s chatbot offers paraphrases, whereas Google offers quotes. Which do we prefer?, in: The New Yorker, 9. Februar 2023, https://www.newyorker.com/tech/annals-of-technology/chatgpt-is-a-blurry-jpeg-of-the-web/; Übersetzung durch DeepL. ↩︎